K-Nearest Neighbors (KNN)

KNN adalah algoritma lazy learning yang memprediksi harga rumah berdasarkan jarak dari rumah-rumah terdekat yang sudah diketahui harganya. Algoritma ini bekerja dengan cara mencari sejumlah tetangga terdekat (K) dari data baru dan menghitung rata-rata harga dari tetangga-tetangga tersebut.

Tertarik untuk menguasai bidang Machine Learning dan mengembangkan portofolio data yang berkualitas? Yuk, segera Sign Up ke DQLab! Disini kamu bisa banget belajar dengan modul berkualitas dan tools sesuai kebutuhan industri dari dasar hingga advanced meskipun kamu nggak punya background IT, lho. Dilengkapi studi kasus yang membantu para pemula belajar memecahkan masalah secara langsung dari berbagai industri.

Tidak cuma itu, DQLab juga sudah menerapkan metode pembelajaran HERO (Hands-On, Experiential Learning & Outcome-based) yang dirancang ramah untuk pemula, dan telah terbukti mencetak talenta unggulan yang sukses berkarier di bidang data. Jadi, mau tunggu apa lagi? Yuk, segera persiapkan diri dengan modul premium atau kamu juga bisa mengikuti Bootcamp Machine Learning and AI for Beginner sekarang juga!

Penulis: Reyvan Maulid

Eko, “149 Juta Anak di Dunia Alami Stunting Sebanyak 6,3 Juta di Indonesia, Wapres Minta Keluarga Prioritaskan Kebutuhan Gizi,” Direktorat Pendidikan Anak Usia Dini, 2023. https://paudpedia.kemdikbud.go.id/berita/149-juta-anak-di-dunia-alami-stunting-sebanyak-63-juta-di-indonesia-wapres-minta-keluarga-prioritaskan-kebutuhan-gizi?do=MTY2NC01YjRhOGZkNA==&ix=MTEtYmJkNjQ3YzA=

T. Beal, A. Tumilowicz, A. Sutrisna, D. Izwardy, and L. M. Neufeld, “A review of child stunting determinants in Indonesia,” Matern. Child Nutr., vol. 14, no. 4, pp. 1–10, 2018, doi: 10.1111/mcn.12617.

M. Wahid and Mujib Rahman, “Rakornas 2023: Pastikan Prevalensi Stunting Turun Menjadi 14% Pada Tahun 2024,” Kementerian Sekretariat Negara RI, 2023. https://stunting.go.id/rakornas-2023-pastikan-prevalensi-stunting-turun-menjadi-14-pada-tahun-2024/

M. Rosyidah, Y. L. R. Dewi, and I. Qadrijati, “Effects of Stunting on Child Development: A Meta-Analysis,” J. Matern. Child Heal., vol. 6, no. 1, pp. 25–34, 2021, doi: 10.26911/thejmch.2021.06.01.03.

A. Heryati, Erduandi, and Terttiaavini, “Penerapan Jaringan Saraf Tiruan Untuk Memprediksi Pencapaian Prestasi Mahasiswa,” in Konferensi Nasional Sistem Informasi 2018 STMIK Atma Luhur Pangkalpinang, 8 – 9 Maret 2018, 2018, pp. 8–9.

D. A. Safitri, D. Fitriani, L. Hertati, T. Terttiavini, A. Heryati, and Asmawati, “PKM Mahasiswa Indo Global Mandiri Pada E-Commerce Marketplace Era Pandemi Covid Meningkat Tajam,” J. Sustain. Community Serv., vol. 1, no. 4, pp. 192–208, 2021.

Hartatik et al., Data Science - Data Science, no. September 2016. 2023. [Online]. Available: https://www.data-science.ruhr/about_us/

D. Marcelina, A. Kurnia, and T. Terttiaavini, “Analisis Klaster Kinerja Usaha Kecil dan Menengah Menggunakan Algoritma K-Means Clustering,” MALCOM Indones. J. Mach. Learn. Comput. Sci., vol. 3, no. October, pp. 293–301, 2023.

M. Tahangnacca, R. Amiruddin, Ansariadi, and A. Syam, “Model of stunting determinants: A systematic review,” Enferm. Clin., vol. 30, pp. 241–245, 2020, doi: 10.1016/j.enfcli.2019.10.076.

M. S. Islam, A. N. Zafar Ullah, S. Mainali, M. A. Imam, and M. I. Hasan, “Determinants of stunting during the first 1,000 days of life in Bangladesh: A review,” Food Sci. Nutr., vol. 8, no. 9, pp. 4685–4695, 2020, doi: 10.1002/fsn3.1795.

T. R. Chowdhury, S. Chakrabarty, M. Rakib, S. Afrin, S. Saltmarsh, and S. Winn, “Factors associated with stunting and wasting in children under 2 years in Bangladesh,” Heliyon, vol. 6, no. 9, 2020, doi: 10.1016/j.heliyon.2020.e04849.

C. Scheffler and M. Hermanussen, “Stunting is the natural condition of human height,” Am. J. Hum. Biol., vol. 34, no. 5, pp. 1–13, 2022, doi: 10.1002/ajhb.23693.

T. Mulyaningsih, I. Mohanty, V. Widyaningsih, T. A. Gebremedhin, R. Miranti, and V. H. Wiyono, “Beyond personal factors: Multilevel determinants of childhood stunting in Indonesia,” PLoS One, vol. 16, no. 11 November, pp. 1–19, 2021, doi: 10.1371/journal.pone.0260265.

T. Huriah and N. Nurjannah, “Risk factors of stunting in developing countries: A scoping review,” Open Access Maced. J. Med. Sci., vol. 8, no. F, pp. 155–160, 2020, doi: 10.3889/oamjms.2020.4466.

M. S. Haris, M. Anshori, and A. N. Khudori, “Prediction of Stunting Prevalence in East Java Province With Random Forest Algorithm,” J. Tek. Inform., vol. 4, no. 1, pp. 11–13, 2023, doi: 10.52436/1.jutif.2023.4.1.614.

Harliana and D. Anggraini, “Penerapan Algoritma Naïve Bayes Pada Klasifikasi Status Gizi Balita di Posyandu Desa Kalitengah (Harliana, Dewi Anggraini),” FAHMA - J. Inform. Komputer, Bisnis dan Manaj., vol. 21, no. 2, pp. 38–45, 2023.

S. Lonang and D. Normawati, “Klasifikasi Status Stunting Pada Balita Menggunakan K-Nearest Neighbor Dengan Feature Selection Backward Elimination,” J. Media Inform. Budidarma, vol. 6, no. 1, p. 49, 2022, doi: 10.30865/mib.v6i1.3312.

T. Terttiaavini, Y. Hartono, E. Ermatita, and D. P. Rini, “Comparison of Simple Additive Weighting Method and Weighted Performance Indicator Method for Lecturer Performance Assessment,” Mod. Educ. Comput. Sci., vol. 15, no. 2, pp. 1–11, 2023, doi: 10.5815/ijmecs.2023.02.01.

T. Terttiaavini, S. amariena Hamim, and S. Agustri, “Aplikasi sistem pakar penentu bidang studi ditingkat perguruan tinggi berbasis web,” J. Ilm. Inform. …, vol. 7, no. 1, pp. 67–72, 2016, [Online]. Available: http://ejournal.uigm.ac.id/index.php/IG/article/view/188

S. Lonang, A. Yudhana, and M. Kunta Biddinika, “Analisis Komparatif Kinerja Algoritma Machine Learning untuk Deteksi Stunting,” J. Media Inform. Budidarma, vol. 7, pp. 2109–2117, 2023, doi: 10.30865/mib.v7i4.6553.

R. Kusumaningrum, T. A. Indihatmoko, S. R. Juwita, A. F. Hanifah, K. Khadijah, and B. Surarso, “Benchmarking of multi-class algorithms for classifying documents related to stunting,” Appl. Sci., vol. 10, no. 23, pp. 1–13, 2020, doi: 10.3390/app10238621.

A. Naik and L. Samant, “Correlation Review of Classification Algorithm Using Data Mining Tool: WEKA, Rapidminer, Tanagra, Orange and Knime,” Procedia Comput. Sci., vol. 85, no. Cms, pp. 662–668, 2016, doi: 10.1016/j.procs.2016.05.251.

KNIME Official, “KNIME Analytics Platform,” 2023. https://www.knime.com/knime-analytics-platform

N. Arminarahmah, A. D. GS, G. W. Bhawika, M. P. Dewi, and A. Wanto, “Mapping the Spread of Covid-19 in Asia Using Data Mining X-Means Algorithms,” IOP Conf. Ser. Mater. Sci. Eng., vol. 1071, no. 1, p. 012018, 2021, doi: 10.1088/1757-899x/1071/1/012018.

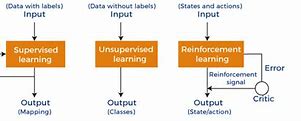

Model machine learning adalah algoritma yang dirancang untuk mempelajari data dan membuat output yang memecahkan masalah manusia. Apa itu algoritma klasifikasi dalam machine learning, dan seberapa berguna setiap model dalam menyelesaikan masalah bisnis kita?

Unsupervised Learning

Kita dapat mebayangkan unsupervised learning sebagai usaha cara menemukan variabel-variabel tertentu dari data. Seperti namanya, unsupervised learning machine learning tidak memiliki pengawasan atau panduan dari manusia dalam mempelajari data. Sebaliknya, mesin diharapkan menghasilkan solusi berdasarkan pembelajaran algoritma.

Unsupervised learning dimaksudkan untuk mengeksplorasi data dan menghasilkan output berdasarkan pembelajaran algoritma. Algoritma memberi umpan dari data training tanpa label dan menghasilkan learning output. perhatikan contoh hasil unsupervised learning dengan algoritma K-Means.

Gambar 2. Hasil unsupervised learning dengan K-Means

Hasil di atas adalah algoritma Clustering yang digunakan untuk mengelompokkan data ke dalam sejumlah group. Pemanfaatan lain dari unsupervised learning adalah Dimensionality Reduction yang menyederhanakan data tanpa kehilangan terlalu banyak informasi dari data asli.

K-Nearest Neighbor (K-NN)

K-Nearest Neighbor atau K-NN adalah algoritma klasifikasi sederhana berbasis jarak data dan masalah optimasi Nearest Neighbor. Tidak seperti model-model sebelumnya, K-NN tidak mempelajari parameter seperti koefisien tetapi hanya menggunakan data aktual sebagai model.

Algoritma K-NN bertujuan untuk mengukur kedekatan data baru dibandingkan dengan data pelatihan yang telah dipelajari sebelumnya oleh model. Alih-alih mempelajari parameter apa pun, model menetapkan K jumlah observasi terdekat untuk mengklasifikasikan data baru.

Cara termudah untuk memahami cara kerja K-NN adalah dengan membayangkan model sebagai peta, dan setiap titik baru ditetapkan ke kelas baru dengan mayoritas jumlah K observasi terdekat menggunakan pengukuran jarak (seringkali Euclidean Distance).

Perhatikan gambar di bawah ini.

Gambar 13. Contoh model K-NN

Gambar di atas menunjukkan data aktual dari dua kelas yang berbeda (biru dan oranye). Bintang adalah data baru yang K-NN mencoba prediksi. Jika kita set K = 3, data baru akan mencari tiga data terdekat. Dengan menggunakan contoh di atas, data baru akan diklasifikasikan sebagai biru karena sebagian besar data terdekat adalah biru. Namun, jika kita meningkatkan K = 5, K-NN akan mengklasifikasikan data baru sebagai oranye karena mayoritas bergeser.

Sebagai catatan, jangan gunakan angka genap untuk K karena klasifikasi akan menjadi prediksi acak jika seri. Menemukan jumlah K yang optimal juga merupakan eksperimen, jadi cobalah mengevaluasi model pembelajaran mesin dengan metrik yang relevan.

Neural Networks adalah model machine learning yang didasarkan pada otak saraf manusia, dan model ini adalah subset dari machine learning yang fokus pada deep learning method. Secara lebih rinci, neural network biasanya terdiri dari tiga komponen simpul (node):

Mari kita lihat gambar di bawah ini untuk mendapatkan detail lebih mendalam.

Gambar 14. Model Neural Network

Secara umum, Anda bisa memiliki jumlah hidden layer yang tak terbatas untuk meningkatkan algoritma. Namun, lebih banyak node berarti daya komputasi dan waktu pelatihan yang semakin tinggi. Jadi, tidak baik jika meningkatkan jumlah layer terlalu tinggi.

Neural network menghitung prediksi dengan menghitung data melalui layer. Data diproses dalam hidden layer node di mana setiap node terdiri dari dua fungis: linear function, dan activation function. Anggaplah fungsi linear sebagai model linear, dan activation function adalah fungsi yang memperkenalkan non-linearitas ke model. Untuk menyelaraskan perhitungan, metode backpropagation digunakan.

Singkatnya, setiap data di layer input akan melewati hidden layer, dan fungsi akan membuat nilai output.

Neural network sering digunakan untuk prediksi data tidak terstruktur, seperti data gambar, teks, atau audio, karena neural network dapat mengonsumsi data ini. Ini juga memungkinkan banyak kasus penggunaan, seperti image recognition, text recognition, dll.

Model machine learning adalah algoritma yang dirancang untuk mempelajari data dan membuat output yang menyelesaikan masalah manusia. Klasifikasi dalam machine learning berkaitan dengan hasil prediksi diskrit.

Kita telah membahas tujuh algoritma klasifikasi berbeda, yaitu:

Support Vector Machine (SVM)

K-Nearest Neighbour (K-NN)

Dalam ilmu komputer, terdapat berbagai macam algoritma untuk menjalankan sebuah machine learning. Membuat algoritma secara manual untuk satu machine learning tentu akan menghabiskan banyak waktu karena tidak efisien. Untungnya, saat ini sudah ada Python libraries yang bisa melakukan semua pekerjaan tersebut.

Reinforcement Learning

Reinforcement learning adalah sistem machine learning yang melakukan tugas dengan memaksimalkan reward melalui tindakan tertentu. Reinforcement learning menggunakan agen untuk mengamati keadaan lingkungan tertentu dan memilih suatu keadaan untuk bertindak. Tindakan akan menghasilkan reward atau penalty tergantung pada pilihan tersebut. Reinforcement learning akan mendorong algoritma untuk menemukan strategi terbaik dalam memaksimalkan reward. Keputusan tersebut kemudian akan menjadi agen dalam suatu lingkungan tertentu.

Kita sering menggunakan reinforcement learning ketika kita tidak memiliki banyak data atau mendapatkan data dengan berinteraksi dengan lingkungan. Contoh reinforcement learning adalah self-driving car dan AI Chess.

Intip Modul DQLab Tentang Algoritma Machine Learning Disini, Yuk!

Dengan modul dan materi yang update, belajar python menggunakan bahasa menjadi lebih mudah dan terstruktur bersama DQLab. Karena terdiri dari modul-modul up-to-date dan sesuai dengan penerapan industri yang disusun oleh mentor-mentor berpengalaman dibidangnya dari berbagai unicorn, dan perusahaan besar seperti Tokopedia, DANA, Jabar Digital dan masih banyak lagi. Yuk, belajar terstruktur dan lebih interaktif cukup dengan Sign up sekarang di DQLab.id atau klik button dibawah ini untuk nikmati pengalaman belajar yang seru dan menyenangkan!

Penulis: Rian Tineges

Editor: Annissa Widya Davita

Algoritma machine learning adalah metode dimana sistem artificial intelligence mengerjakan tugasnya secara otomatis. Umumnya algoritma machine learning ini digunakan untuk memprediksi nilai output dari input yang diberikan. Dua proses utama dari algoritma machine learning adalah klasifikasi dan regresi.

Algoritma machine learning sendiri dibagi menjadi dua, yaitu supervised dan unsupervised learning. Supervised learning membutuhkan data input dan data output yang diinginkan dan digunakan untuk membuat pelabelan, sedangkan algoritma unsupervised learning bekerja dengan data yang tidak diklasifikasikan atau tidak diberi label.

Contoh algoritma unsupervised learning adalah pengelompokan atau clustering data yang tidak difilter berdasarkan persamaan dan perbedaan. Pada artikel kali ini, kita akan membahas algoritma supervised learning, yaitu algoritma klasifikasi atau classification.

Terkadang sulit memutuskan algoritma machine learning mana yang paling baik untuk klasifikasi diantara banyaknya pilihan dan jenis algoritma klasifikasi yang ada. Namun, ada algoritma klasifikasi machine learning yang paling baik digunakan dalam masalah atau situasi tertentu.

Algoritma klasifikasi ini digunakan untuk klasifikasi teks, analisis sentimen, deteksi spam, deteksi penipuan, segmentasi pelanggan, dan klasifikasi gambar. Pilihan algoritma yang sesuai bergantung pada kumpulan data dan tujuan yang akan dicapai.

Lalu apa saja algoritma klasifikasi terbaik tersebut? Yuk simak artikel kali ini hingga akhir!

Source: Thanmai Chandaka

Decision tree membangun model klasifikasi dan regresi dalam bentuk struktur pohon. Algoritma ini menguraikan kumpulan data menjadi himpunan bagian yang lebih kecil dan menghubungkannya menjadi pohon keputusan yang terkait. Tujuan utama dari algoritma decision tree adalah untuk membangun model pelatihan yang digunakan untuk memprediksi nilai variabel target dengan mempelajari aturan keputusan. Aturan ini disimpulkan dari data training yang sebelumnya telah diinput. Keuntungan algoritma ini adalah mudah dimengerti, mudah menghasilkan aturan, tidak mengandung hiper-parameter, dan model decision tree yang kompleks dapat disederhanakan secara signifikan dengan visualisasinya.

Decision tree membangun model klasifikasi dan regresi dalam bentuk struktur pohon. Algoritma ini menguraikan kumpulan data menjadi himpunan bagian yang lebih kecil dan menghubungkannya menjadi pohon keputusan yang terkait.

Tujuan utama dari algoritma decision tree adalah untuk membangun model pelatihan yang digunakan untuk memprediksi nilai variabel target dengan mempelajari aturan keputusan. Aturan ini disimpulkan dari data training yang sebelumnya telah diinput.

Keuntungan algoritma ini adalah mudah dimengerti, mudah menghasilkan aturan, tidak mengandung hiper-parameter, dan model decision tree yang kompleks dapat disederhanakan secara signifikan dengan visualisasinya.

Baca juga : Yuk Kenali Macam-Macam Algoritma Machine Learning!

Library Python Terbaik Untuk Machine Learning

Algoritma Python menyediakan berbagai library yang dapat digunakan untuk membangun machine learning. Beberapa library yang sering digunakan yaitu:

Scikit-Learn dikembangkan oleh David Cournapeau pada tahun 2007 dimana bersifat open source dan digunakan untuk machine learning. Library ini sangat baik dalam mendukung berbagai tipe machine learning seperti unsupervised learning dan supervised learning serta sempurna digunakan untuk analisis data dan data mining.

Keras merupakan library machine learning Python yang dirilis di bawah lisensi MIT. Keras dikembangkan untuk membuat pembelajaran machine learning yang mendalam dengan secepat dan semudah mungkin.

TensorFlow merupakan library paling populer untuk machine learning bersifat open source yang dikembangkan oleh tim Google Brain dan dirilis pada tahun 2015 dibawah lisensi Apache 2.0. Arsitektur yang dimiliki TensorFlow fleksibel dengan beragam toolkit. Library ini cocok diimplementasikan dalam AI dan deep learning dan dapat digunakan pada beberapa platform komputasi seperti CPU, GPU, dan TPU.

Algoritma Klasifikasi pada Machine Learning

Kita telah memahami dasar untuk setiap sistem machine learning dan bagaimana masalah yang berbeda memerlukan algoritma yang berbeda. Secara umum, sebagian besar masalah di industri adalah masalah klasifikasi, sehingga akan berguna bagi kita untuk memahami lebih lanjut tentang algoritma klasifikasi.

Mari kita pahami tujuh algoritma klasifikasi yang paling sering digunakan dan kapan masing-masing algoritma bisa digunakan.

Support Vector Machine

SVM (Support Vector Machine) adalah algoritma klasifikasi yang memiliki kinerja yang bagus, tingkat keakuratan yang dinilai cukup tinggi untuk pengklasifikasian data, dan error rate yang dihasilkan minimum. Adapun keuntungan dari algoritma SVM adalah dapat menentukan hyperplane atau pemisah dengan memilih bidang yang memiliki optimal margin maka generalisasi pada SVM dapat terjaga dengan sendirinya, tingkat generalisasi pada SVM tidak dipengaruhi oleh jumlah data latih , dengan menentukan parameter soft margin, noise dapat dikontrol pada kesalahan klasifikasi sehingga proses pelatihan menjadi jauh lebih ketat.

Algoritma KNN atau sering disebut K-Nearest Neighbor merupakan algoritma yang melakukan klasifikasi berdasarkan kedekatan jarak suatu data dengan data yang lain. Dekat atau jauh suatu jarak dihitung berdasarkan jarak Euclidean. KNN merupakan salah satu algoritma non parametrik yang digunakan dalam pengklasifikasian. Selain naive bayes, algoritma KNN juga menjadi algoritma pengklasifikasian yang terkenal dengan tingkat keakuratan yang baik. Keuntungan dari algoritma KNN adalah sangat nonlinear, lebih mudah dipahami dan diimplementasikan karena kita cukup mendefinisikan fungsi untuk menghitung jarak antar-instance, menghitung jarak x dengan semua instance lainnya berdasarkan fungsi tersebut dan menentukan kelas x sebagai kelas yang paling banyak muncul di k-instance.

Baca juga : Belajar Data Science: Pahami Penggunaan Machine Learning pada Python

Mulai Belajar Menjadi Data Scientist dari Sekarang!

Tahukah kalian bahwa data scientist kini sangat banyak diminati oleh berbagai kalangan. Data scientist merupakan profesi terseksi di abad ini serta gaji dan jenjang karirnya pun cukup menjanjikan. Jadi, Untuk mengetahui lebih lanjut terkait data scientist kita dapat mempelajarinya di DQLab lohh. Caranya sangat mudah, yaitu cukup signup di DQLab dan nikmati momen belajar gratis bersama DQLab dengan mengakses module gratis dari R, Python atau SQL!

Penulis : Latifah Uswatun Khasanah

Editor : Annissa Widya Davita

Untuk dapat menemukan pola dibalik suatu dataset agar bisa lebih bermanfaat lagi, diperlukan sebuah algoritma machine learning. Machine learning sendiri membahas tentang bagaimana cara mesin dapat belajar sendiri sehingga mesin tersebut dapat melakukan tugas tertentu tanpa terprogram secara eksplisit. Tidak seperti AI yang dapat meniru kemampuan manusia dalam merespon suatu sistem, machine learning justru mampu membuat algoritmanya sendiri untuk proses belajar. Konsep kerja machine learning dalam menggunakan algoritma yang telah terprogram adalah dengan menerima dan menganalisis data inputan untuk kemudian dapat memprediksi nilai keluaran atau output.

Berdasarkan algoritma-algoritma tersebut terdiri dari tiga tipe algoritma diantaranya Supervised Learning, Unsupervised Learning, dan Reinforcement Learning. Pada kesempatan kali ini, kami akan membahas tentang empat rekomendasi algoritma machine learning yang digunakan untuk pengklasifikasian. Jadi, jangan beranjak dan baca artikel DQLab sampai selesai, ya!

Random forest merupakan salah satu algoritma yang digunakan untuk pengklasifikasian dataset dalam jumlah besar. Klasifikasi random forest dilakukan melalui penggabungan tree dengan melakukan training dataset yang kamu miliki. Selain itu, algoritma random forest menggunakan algoritma decision tree untuk melakukan proses seleksi. Dimana tree atau pohon yang dibangun dibagi secara rekursif dari data pada kelas yang sama. Proses klasifikasi pada random forest berawal dari memecah data sampel yang ada dalam decision tree secara acak. Setelah pohon terbentuk,maka akan dilakukan voting pada setiap kelas dari data sampel. Kemudian, mengkombinasikan vote dari setiap kelas kemudian diambil vote yang paling banyak.Dengan menggunakan random forest pada klasifikasi data maka, akan menghasilkan vote yang paling baik. Pada saat proses klasifikasi selesai dilakukan, inisialisasi dilakukan dengan sebanyak data berdasarkan nilai akurasinya. Keuntungan penggunaan random forest yaitu mampu mengklasifikasi data yang memiliki atribut yang tidak lengkap,dapat digunakan untuk klasifikasi dan regresi akan tetapi tidak terlalu bagus untuk regresi, lebih cocok untuk pengklasifikasian data serta dapat digunakan untuk menangani data sampel yang banyak.

Baca juga : 3 Jenis Algoritma Machine Learning yang Dapat Digunakan di Dunia Perbankan

Naive bayes merupakan metode pengklasifikasian paling populer digunakan dengan tingkat keakuratan yang baik. Banyak penelitian tentang pengklasifikasian yang telah dilakukan dengan menggunakan algoritma ini. Berbeda dengan metode pengklasifikasian dengan logistic regression ordinal maupun nominal, pada algoritma naive bayes pengklasifikasian tidak membutuhkan adanya pemodelan maupun uji statistik. Naive bayes merupakan metode pengklasifikasian berdasarkan probabilitas sederhana dan dirancang agar dapat dipergunakan dengan asumsi antar variabel penjelas saling bebas (independen). Pada algoritma ini pembelajaran lebih ditekankan pada pengestimasian probabilitas. Keuntungan algoritma naive bayes adalah tingkat nilai error yang didapat lebih rendah ketika dataset berjumlah besar, selain itu akurasi naive bayes dan kecepatannya lebih tinggi pada saat diaplikasikan ke dalam dataset yang jumlahnya lebih besar.

Naive Bayes Classifier

Source: Koushiki Dasgupta Chauduri

Naive bayes classifier merupakan algoritma klasifikasi yang sangat sederhana berdasarkan apa yang disebut pada teorema bayesian. Algoritma ini memiliki satu sifat umum, yaitu setiap data diklasifikasikan tidak bergantung pada fitur lain yang terikat pada kelas atau biasa disebut dengan independen. Artinya, satu data tidak berdampak pada data yang lain.

Meskipun algoritma ini merupakan algoritma yang tergolong sederhana, namun naive bayes dapat mengalahkan beberapa metode klasifikasi yang lebih canggih. Algoritma ini biasa digunakan untuk deteksi spam dan klasifikasi dokumen teks.

Kelebihan algoritma ini adalah sederhana dan mudah diterapkan, tidak sensitif terhadap fitur yang tidak relevan, cepat, hanya membutuhkan sedikit data training, dan dapat digunakan untuk masalah klasifikasi multi-class dan biner.